Kontinuierliche Prozessüberwachung in Echtzeit

Live-Dashboards, SLA-Alerts und KI-gestützte Anomaly Detection für laufende Geschäftsprozesse

Prozessoptimierung zeigt Wirkung, wenn sie einmal durchgeführt wurde. Prozessüberwachung stellt sicher, dass diese Wirkung anhält. Der Unterschied ist entscheidend: Während eine einmalige Analyse Schwachstellen identifiziert und behebt, erkennt ein kontinuierliches Monitoring sofort, wenn ein optimierter Prozess wieder aus dem Ruder läuft, neue Engpässe entstehen oder SLA-Zeiten zu kippen drohen.

Elasticbrains entwickelt maßgeschneiderte Process-Monitoring-Lösungen, die laufende Geschäftsprozesse in Echtzeit überwachen. Wir kombinieren Process Mining auf Live-Daten, Time-Series-Analyse und unternehmens-eigene KI-Modelle zu Frühwarnsystemen, die Abweichungen erkennen, bevor sie sich zu Problemen entwickeln. Das Ergebnis: Operations-Teams handeln proaktiv statt reaktiv.

Überwachung versus Optimierung: Was ist der Unterschied?

Viele Unternehmen verwechseln Prozessoptimierung und Prozessüberwachung oder setzen nur eines davon ein. Beide haben unterschiedliche Aufgaben und ergänzen sich.

Einmalige oder periodische Analyse, Neugestaltung und Verbesserung eines Prozesses. Ergebnis: ein optimierter Soll-Zustand.

Zur ProzessoptimierungKontinuierliches Live-Tracking, ob der optimierte Prozess weiterhin so läuft wie vorgesehen. Ergebnis: anhaltende Wirksamkeit und sofortige Reaktionsfähigkeit.

Was kontinuierliches Process Monitoring bringt

Sofortige Sichtbarkeit

Abweichungen vom Soll-Prozess werden innerhalb von Sekunden sichtbar, nicht erst beim nächsten Quartalsreview. Operations-Teams reagieren auf Fakten, nicht auf Bauchgefühl.

SLA-Compliance dauerhaft sichern

Automatische SLA-Alerts eskalieren, bevor eine Frist verletzt wird. Das gilt für Ticket-Bearbeitung, Lieferzeiten, Schadensregulierung oder jede andere prozessgebundene Vereinbarung.

Anomalien früh erkennen

KI-Modelle lernen das normale Prozessverhalten und schlagen Alarm, wenn Muster abweichen, die für Menschen noch unsichtbar sind. Frühwarnung statt Brandalarm.

Process Mining auf echten Daten

Statt auf Annahmen basieren Process-Mining-Auswertungen auf tatsächlichen Event-Logs aus ERP, CRM und Produktionssystemen. So wird sichtbar, wie Prozesse wirklich ablaufen.

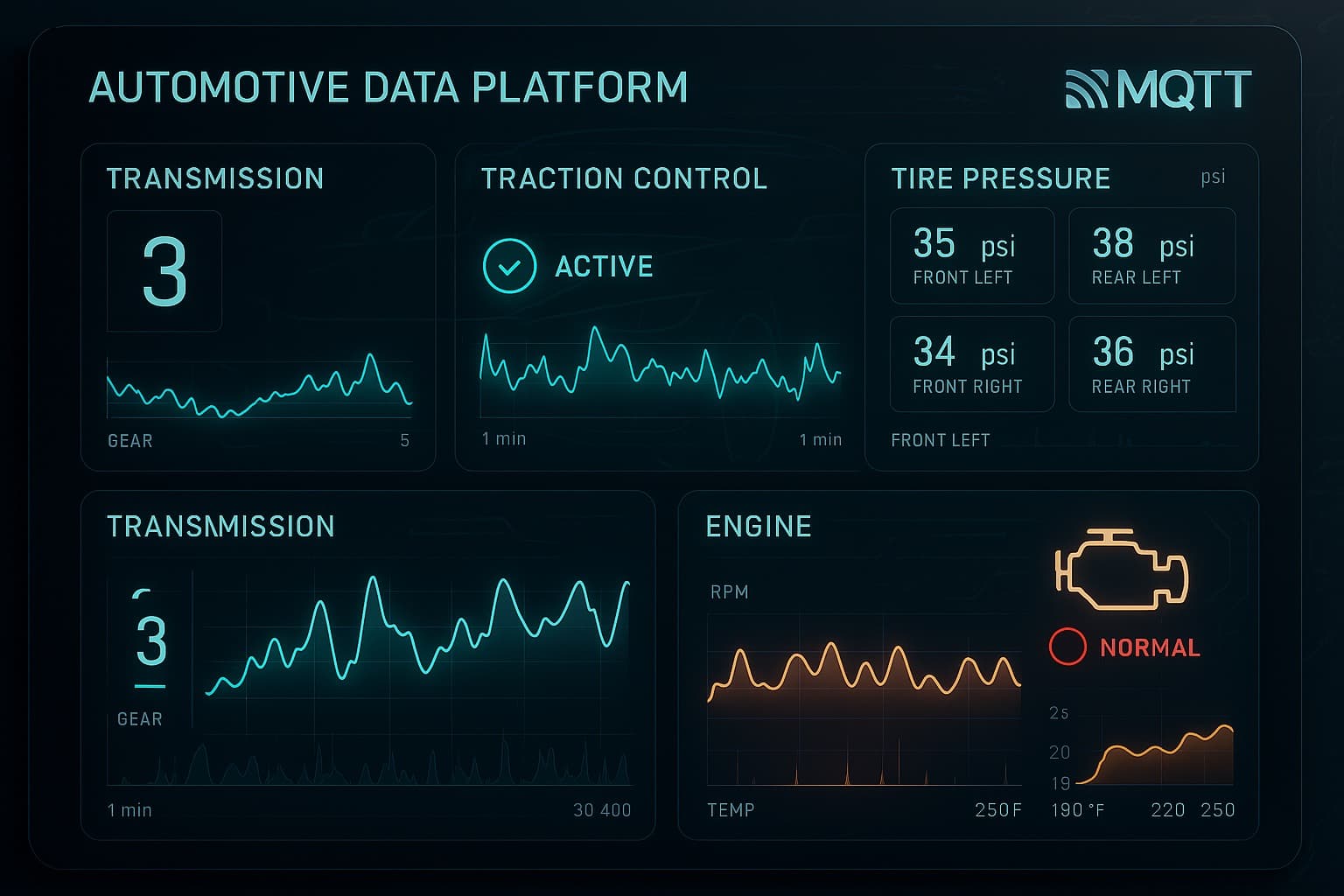

Kernfunktionen unserer Monitoring-Plattformen

Live-Dashboards pro Prozess-KPI

Jeder Prozess bekommt ein dediziertes Dashboard mit den KPIs, die für ihn relevant sind: Durchlaufzeit, Wartezeiten, Fehlerrate, Auslastung. Konfigurierbar nach Rolle: COO, Operations Manager, Teamleiter.

SLA-Alerts und Eskalationsregeln

Schwellenwerte werden pro Prozess und SLA-Klasse definiert. Unterschreitet ein Vorgang die konfigurierte Bearbeitungszeit nicht, wird automatisch eskaliert, per E-Mail, Teams-Nachricht oder Ticket.

Process Mining auf Live-Daten

Auf Basis von Event-Logs aus Produktivsystemen rekonstruieren Process-Mining-Algorithmen den tatsächlichen Prozessfluss. Abweichungen vom Soll-Prozess werden als Conformance-Score sichtbar gemacht.

Bottleneck-Detection

Engpässe zeigen sich im Monitoring als Stauungen: Stellen, an denen Vorgänge warten, während andere Schritte schnell durchlaufen. Automatische Heatmaps zeigen, wo der Prozess hängt.

KI-gestützte Anomaly Detection

Machine-Learning-Modelle lernen die normalen Zeitfenster, Mengen und Sequenzen eines Prozesses. Weicht ein laufender Vorgang statistisch ab, wird ein Alert generiert, konfigurierbar nach Sensitivität.

Zeitreihen-Historisierung

Alle Prozessdaten werden zeitstempelgenau in Time-Series-Datenbanken gespeichert. So lassen sich Trends über Monate visualisieren und saisonale Muster erkennen.

Anwendungsfälle aus der Praxis

Auftragsdurchlauf in der Produktion

Ein Fertigungsunternehmen überwacht jeden Produktionsauftrag vom Eingang bis zur Auslieferung. SLA-Alerts greifen, wenn ein Auftrag eine Station zu lange belegt. Bottleneck-Detection zeigt, welche Maschinen chronisch überlasten.

Schadensregulierung in der Versicherung

Versicherungsunternehmen müssen Schäden innerhalb regulatorischer Fristen bearbeiten. Process Monitoring überwacht jeden Schadensfall in Echtzeit und eskaliert, bevor eine Frist verletzt wird.

IT-Incident-Lifecycle

IT-Organisationen überwachen Support-Tickets vom Eingang bis zur Lösung. SLA-Monitoring unterscheidet nach Prioritätsklassen, Anomaly Detection erkennt ungewöhnliche Ticket-Wellen als frühes Anzeichen systemischer Probleme.

Ticket-Bearbeitungs-SLAs

Servicecenter mit definierten Reaktionszeiten nutzen Process Monitoring zur lückenlosen SLA-Compliance. Dashboards zeigen in Echtzeit, wie viele Tickets welcher Priorität noch innerhalb der Frist liegen.

Lieferketten-Monitoring

Logistikprozesse werden vom Bestelleingang bis zur Ankunft beim Kunden überwacht. Abweichungen bei Lieferzeiten, Dokumentenfreigaben oder Zollprozessen werden sofort sichtbar.

Qualitätsprozesse in der Produktion

Qualitätsprüfungen werden als Prozessschritte erfasst. Steigt die Fehlerrate an einer Station, löst das Monitoring sofort einen Alert aus, bevor eine größere Charge betroffen ist.

Technologie-Stack

Wir wählen den Tech-Stack nach Ihren Anforderungen: Datenmenge, Latenzanforderungen, vorhandene Systemlandschaft und Security-Vorgaben.

Process Mining auf Event-Logs aus ERP, CRM und Produktionssystemen. Rekonstruktion des tatsächlichen Prozessflusses und Conformance-Checking gegen den Soll-Prozess.

Spezialisierte Datenbanken für zeitstempelgenaue Prozessdaten mit schnellen Aggregationsabfragen. TimescaleDB auf PostgreSQL-Basis für einfache Integration in bestehende Infrastruktur.

Hochdurchsatz-Streaming für Produktionsumgebungen mit tausenden gleichzeitiger Events. Kafka als Backbone für lose Kopplung zwischen Quellsystemen und Monitoring-Plattform.

Unternehmens-eigene ML-Modelle, die auf historischen Prozessdaten trainiert werden. Isolation Forest, LSTM-Autoencoder und statistische Verfahren je nach Prozesscharakteristik.

Grafana für schnelle Einführung operativer Dashboards. Custom-Dashboards in Vue.js mit D3.js für prozess-spezifische Visualisierungen und rollenbasierte Ansichten.

Daten werden dort abgeholt, wo sie entstehen: direkt aus ERP-Systemen (SAP, Microsoft Dynamics), aus MQTT-basierten IoT-Netzwerken oder per Event-Hooks aus Cloud-Plattformen.

Unser Vorgehen

- Prozess- und Daten-Assessment: Wir identifizieren, welche Prozesse überwacht werden sollen, welche KPIs und SLAs relevant sind und wo die Event-Daten entstehen. Daraus entsteht das Monitoring-Konzept.

- Datenpipeline aufbauen: Anbindung der Quellsysteme, Aufbau der Streaming-Infrastruktur und Einrichtung der Time-Series-Datenbank. Daten fließen, bevor Dashboards konfiguriert werden.

- Baseline und Modell-Training: Aus historischen Prozessdaten wird eine Baseline des Normverhaltens abgeleitet. ML-Modelle für Anomaly Detection werden auf diesen Daten trainiert und validiert.

- Dashboard- und Alert-Konfiguration: KPI-Dashboards werden nach Rolle und Prozess konfiguriert. SLA-Schwellenwerte und Eskalationsregeln werden gemeinsam mit Operations und Fachbereich definiert.

- Produktivbetrieb und Iteration: Das Monitoring geht in Produktion. In den ersten Wochen werden Schwellenwerte und Alert-Sensitivität angepasst, bis das System nur relevante Alarme auslöst.

Prozessüberwachung zeigt, wo optimiert werden muss. Prozessoptimierung führt die Verbesserung durch.

Zur ProzessoptimierungFür strategische Auswertungen und unternehmensweite Dashboards jenseits des operativen Monitorings.

Zur Business IntelligenceHäufige Fragen

Was ist der Unterschied zwischen Process Monitoring und Prozessoptimierung?

Prozessoptimierung ist eine gezielte, oft einmalige Massnahme: ein Prozess wird analysiert, neu gestaltet und verbessert. Process Monitoring ist dauerhaft aktiv: es überwacht kontinuierlich, ob der optimierte Prozess so läuft wie vorgesehen, erkennt neue Abweichungen sofort und liefert die Datenbasis für weitere Optimierungsrunden. Beide ergänzen sich, lösen aber unterschiedliche Probleme.

Welche Datenquellen können angebunden werden?

Nahezu alle strukturierten Quellen: ERP-Systeme (SAP, Microsoft Dynamics), CRM-Plattformen, Ticketsysteme (Jira, ServiceNow), MQTT-basierte IoT-Netzwerke, Produktionsdatenbanken, Cloud-APIs oder Datenbank-Change-Streams. Die Anbindung erfolgt über REST, Webhooks, Kafka-Konnektoren oder native Datenbank-Integrationen.

Wie funktioniert die KI-gestützte Anomaly Detection?

Zunächst wird aus historischen Event-Daten das Normverhalten eines Prozesses gelernt: typische Durchlaufzeiten, Sequenzen, Mengen und Zeitfenster. ML-Modelle wie Isolation Forest oder LSTM-Autoencoder erkennen dann laufende Vorgänge, die statistisch signifikant vom Normverhalten abweichen. Die Sensitivität ist konfigurierbar, damit nur relevante Alarme ausgelöst werden.

Wie lange dauert die Einführung eines Monitoring-Systems?

Ein erstes operatives Dashboard mit grundlegenden SLA-Alerts ist oft in zwei bis vier Wochen produktiv, sobald die Datenpipeline steht. Vollständiges Process Mining mit trainierter Anomaly Detection und rollenbasierten Dashboards braucht in der Regel sechs bis zehn Wochen, je nach Komplexität der Prozesse und Anzahl der Quellsysteme.

Ist Process Monitoring auch für kleinere Unternehmen sinnvoll?

Ja, sobald Prozesse SLA-kritisch sind oder Fehler im Ablauf direkte Kosten verursachen. Auch Mittelstandsunternehmen haben Prozesse, bei denen ein manueller Überblick nicht mehr ausreicht: Auftragsabwicklung, Reklamationsbearbeitung, Onboarding-Prozesse. Eine skalierte Lösung ohne Enterprise-Overhead ist in diesen Fällen machbar.

Bereit für Ihr Projekt?

Lassen Sie uns in einem unverbindlichen Erstgespräch klären, wie wir Sie am besten unterstützen können.

Kostenlos · Unverbindlich · Persönliche Erstberatung durch erfahrene Münchner Experten